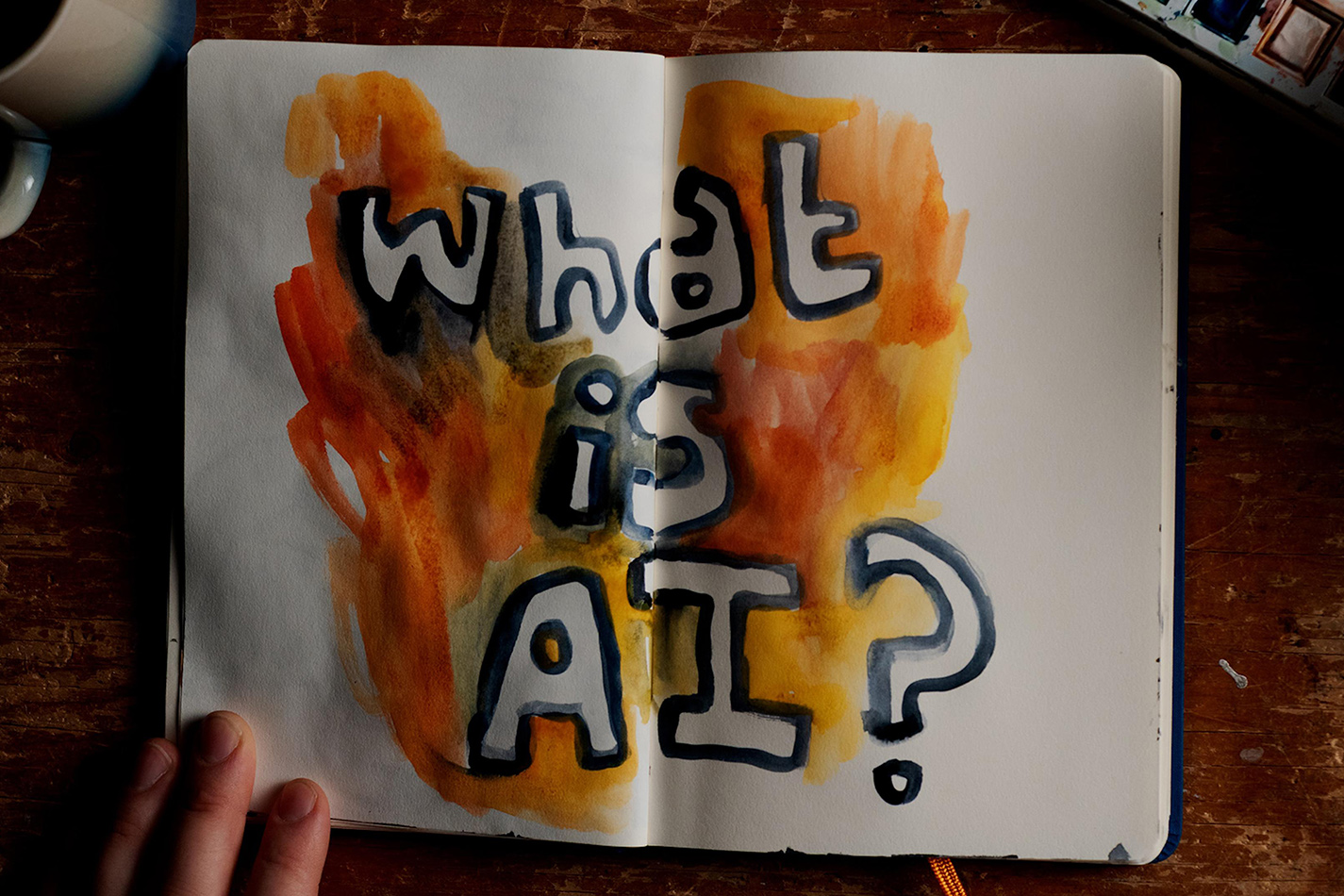

Роэр и Тайрелл изначально планировали выпустить фильм в 2024 году, но технологии искусственного интеллекта развиваются настолько стремительно, что собранная информация устаревала быстрее, чем они успевали осмыслить ее и сделать частью картины. В результате работа над проектом растянулась на три года. В 2024 году оба режиссера стали отцами, в их семьях с разницей в несколько недель появились дети, и поэтому Тайрелл и Роэр вместо того, чтобы рассказывать о том, что представляет собой ИИ сегодня, попытались снять фильм о том мире, в котором будут жить их потомки.

Создатели дока смогли собрать впечатляющий ростер спикеров. Своим мнением об ИИ поделились глава OpenAI Сэм Альтман и требовавший его отставки сооснователь OpenAI Илья Суцкевер, основатели Anthropic Дарио и Даниэла Амодеи, руководитель Google DeepMind Демис Хассабис, лауреат премии Тьюринга Джошуа Бенжио, а также писатель и философ Элиезер Юдковский, один из наиболее известных сторонников жесткого контроля над искусственным интеллектом и автор популярного фанфика «Гарри Поттер и методы рационального мышления». Рассуждая о будущем, они придерживались полярных позиций: одни предвещают грядущий цифровой апокалипсис, другие же с безудержным оптимизмом обещают технократическую утопию, где «вкалывают роботы, а не человек». Роэр и Тайрелл в своем доке пытаются предложить третий путь, который они назвали «апокалиптимизм»: не пытаться отрицать серьезность вставших перед человечеством проблем, но сохранять веру в то, что при должной осторожности мы сможем преодолеть трудности.

Американский специалист по технологической этике, соучредитель Центра гуманных технологий Тристан Харрис, ставший одним из спикеров фильма, подчеркивает, что в настоящее время ведущие IT-компании ведут гонку за созданием самой мощной, непостижимой и неконтролируемой технологии из всех, с которыми когда-либо имело дело человечество. И в попытке получить преимущество над конкурентами в этой гонке они пытаются срезать углы, в том числе за счет экономии на безопасности. Ведущие исследователи в области машинного обучения, включая вышеупомянутого Илью Суцкевера и соучредителя DeepMind Шейна Легга, соглашаются, что есть аспекты работы моделей искусственного интеллекта, которые люди не могут и никогда не смогут понять. Стандартные модели ИИ уже сейчас обучаются на большем объеме данных, чем любой человек смог бы прочитать за несколько жизней. Тайрелл и Роэр понимают, что прогресс не остановить, но призывают усилить контроль за разработкой ИИ и начать координировать эти вопросы на международном уровне.

Смотрите фильм «Док об ИИ, или Как я стал апокалиптимистом» в онлайн-кинотеатре Apple TV с 27 марта.

Читайте также: Украденные голоса. Как ИИ меняет индустрию озвучивания

Заглавное фото: постер фильма «Док об ИИ, или Как я стал апокалиптимистом». Фото: imdb